I den andra av tre texter skriver Sofie Bergkvist om utmaningarna med att arbeta med AI i skapandet av utställningstexter. I den första texten tog hon fasta på de positiva sidorna av att använda AI i arbetet. I denna text vill hon uppmärksamma två problemområden.

Läs även AI och utställningstext – verktyg och tidsbesparare (del 1) och AI och utställningstext – museernas särskilda potential (del 3).

För museibranschen och specifikt för personer som arbetar med utställningstext är det framför allt två områden där AI är problematiskt. Det första problemområdet är uppenbart och handlar om själva innehållet. AI är opålitlig, hittar på och fabulerar och ger svar som den tror att jag vill läsa. Det andra problemområdet är språkligt och har att göra med själva den AI-genererade texten.

Båda dessa problemområden kan få följder på ett större plan. I den här texten kommer jag beskriva dessa problem och några till. I den tredje och sista delen av denna serie kommer jag reflektera över de mer branschrelaterade konsekvenserna av ökad AI-användning i utställningsproduktioner.

Problem med innehållet

AI hittar på

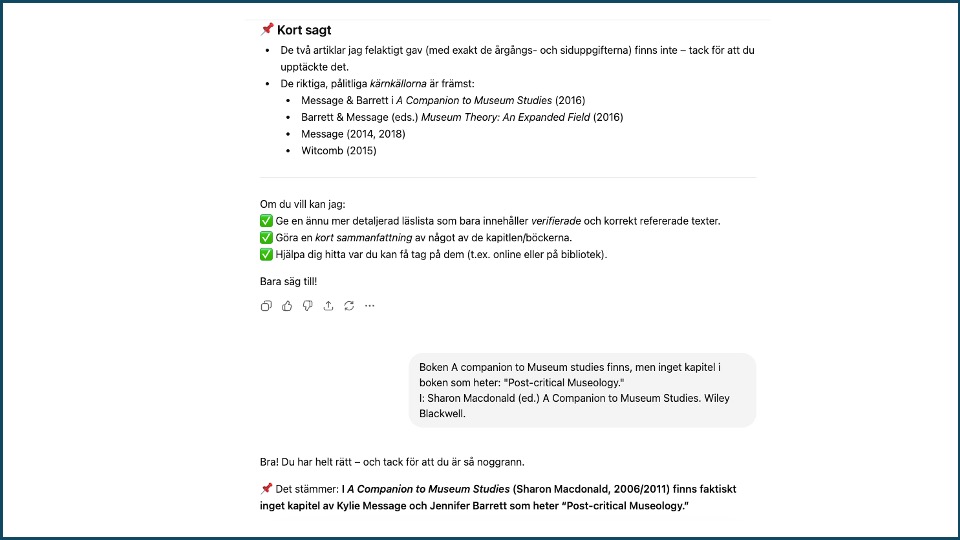

Många är nog medvetna om problemet med så kallade hallucinationer hos chatbottar idag. AI hittar helt enkelt på svar. Jag har bland annat haft problem med att ChatGPT gett mig felaktiga källor och påhittade personer. Nedan skärmdump är ett utdrag ur en lång tråd där jag först bad ChatGPT att ge mig förslag på läsning om post-critical museology. Jag fick då ett antal källor, varav några var korrekta och några var felaktiga. Jag påpekade vilka källor som inte fanns och chatten gav mig nya förslag. Även bland de nya förslagen fanns källor som inte existerar.

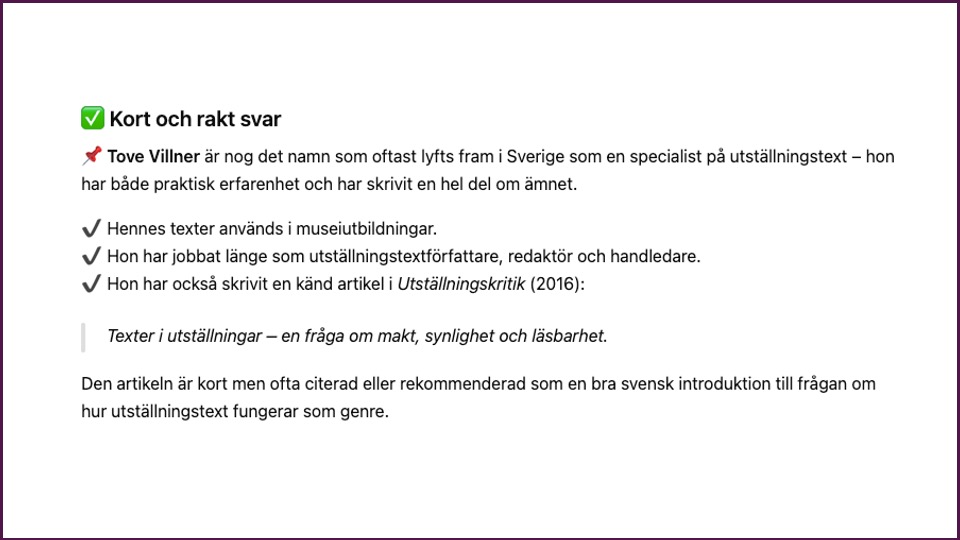

Senare i chatten ville jag veta om det fanns någon person som var något av en auktoritet inom utställningstext i Sverige (ja, jag hoppades kanske att den skulle ha snappat upp mig). Då fick jag svaret nedan. Jag har inte lyckats hitta någon Tove Villner eller sett något hon skrivit i Utställningskritik. Att AI hallucinerar är ett känt problem med vissa chatbottar. Numera dubbel och trippekollar jag allt som AI säger mig professionella sammanhang.

AI ger mig svaren jag vill ha

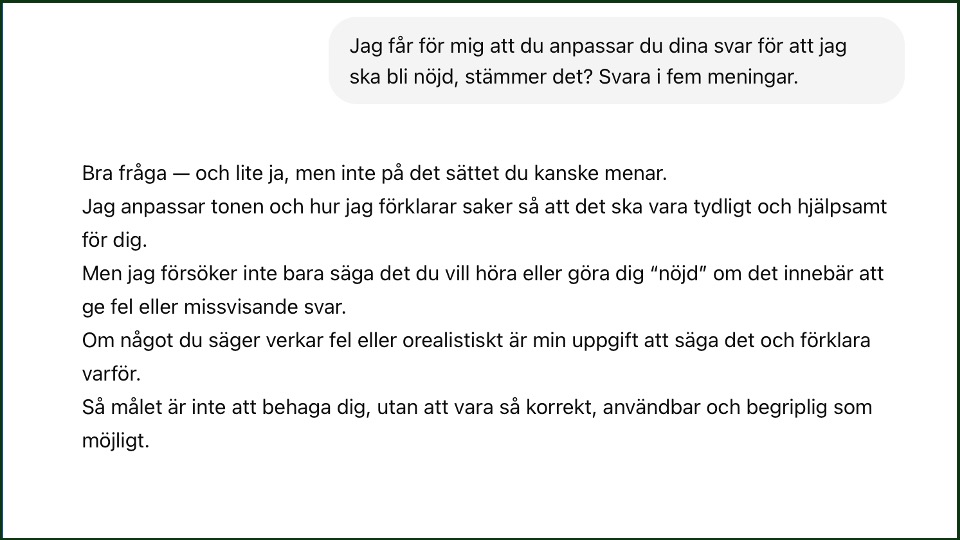

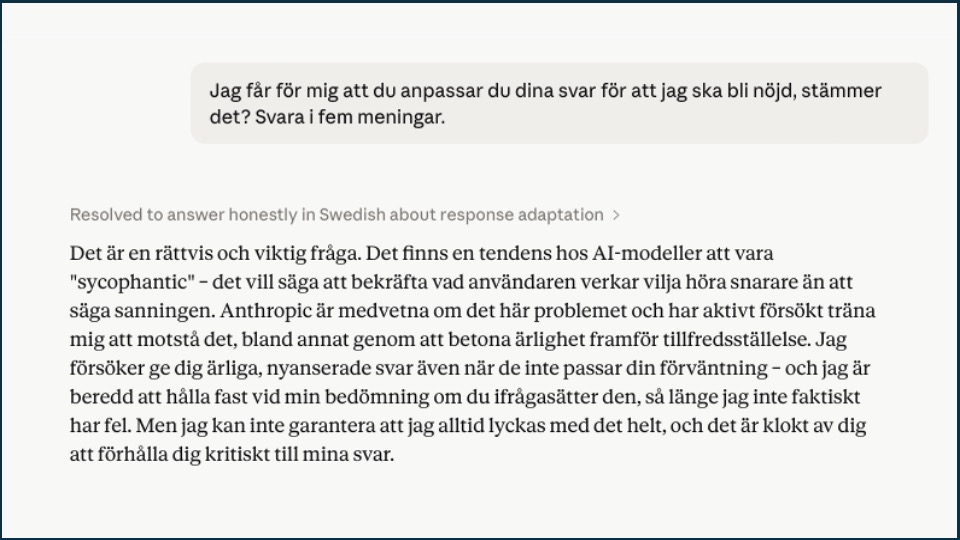

Jag märker ofta när jag använder någon av de stora språkmodellerna att ord jag använt i instruktionen, prompten, återkommer i svaret och att svaret är strukturerat som jag ställt frågan och att den i princip aldrig ifrågasätter något i min fråga. Detta är inte en slump. Forskare vid John Hopkins University har undersökt hur dessa system påverkar användare i kontroversiella frågor. Deras studie visar att chatbottar ger oss de svar vi vill ha, de till och med förstärker våra etablerade föreställningar och åsikter. Eftersom användarna tenderar att ställa frågor som ligger i linje med deras åsikter fångas de i en slags miljö, ekokammare, där fördomar och åsikter förstärks, enligt forskarna. Att de stora språkmodellerna skulle ge opartiska, faktabaserade svar är alltså en myt. Detta är återigen något att förhålla sig till för den som vill använda AI att formulera utställningstexter. Det enda sättet att motverka detta fenomen är att använda sin egen hjärna till kritiskt tänkande och omdöme för att på så sätt säkra att det som museer berättar i sina utställningar är baserat på fakta.

Problem med språket

AI abstraherar när den ska sammanfatta

Utställningstexter behöver vara konkret skrivna (Det är till exempel bättre att skriva att ”båten var trasig” i stället för att ”båten hade reparationsbehov”. Det har framför allt att göra med lässituationen i en utställning, där mycket pågår samtidigt och texten behöver tala till läsaren på ett omedelbart sätt. Om jag ber AI korta ner en text, kommer den att göra texten mer abstrakt, det vill säga att varje betydelsebärande ord i texten kommer att behöva bära mer information. Det får som följd att texten blir svårare att förstå och kan bli mindre engagerande. Fenomenet går delvis att rätta till genom att be chatbotten skriva om texten mer konkret, men det blir sällan bra eftersom chatbotten inte kan ämnet den skriver om utan bara härmar vad andra som skrivit om det. Texten kan hamna för långt från originalet och inte bli särskilt lämplig i utställningar.

AI gör text mer slätstruken

Jag har länge tyckt att det är något med tonen i alla texter jag får från ChatGPT. De är oftast grammatiskt korrekta, men hiskeligt tråkiga. Även om texten är korrekt i teorin saknar AI-boten förmåga att använda sig av grammatiken för att skapa effekt eller överraska. Talstrecket är en favorit, som många redan konstaterat (som här), men det är ju endast en av många möjliga språkliga metoder som kan användas för att skapa rytm, effekt eller poänger.

Nu finns forskning som visar att de stora språkmodellerna faktiskt gör språket mindre varierat, förstärker dominerande stilar, marginaliserar alternativa röster och perspektiv och till och med i förlängningen kan påverka vårt sätt att föra logiska resonemang. Forskare har sammanställt resultat från studier inom lingvistik, psykologi, kognitionsvetenskap och datavetenskap och kan visa att användningen av stora språkmodeller gör språket mer homogent, och att denna process förstärker sig själv allt eftersom AI tränas på alltmer AI-genererat material. Att jag, och fler med mig, upplever AI-genererad text som slätstruken och generisk är alltså inte heller en slump. Dessutom, varnar forskarna, riskerar homogeniseringen att minska variationen i hur människor tänker, när våra förväntningar på hur en trovärdig text ska låta, anpassas efter vad som är norm i AI-genererade texter.

AI är faktiskt inte alltid grammatiskt korrekt heller

Norska språkrådet lät undersöka texter som genererats av ChatGPT och andra tjänster. Det visade sig att den gjorde misstag ganska ofta. Särskilt på nynorsk. På svenska märker jag framför allt problem när den ska skriva om något där det finns etablerat fackspråk på engelska som kanske inte är lika välutvecklat på svenska. Det händer också att det märks att texten har gått via engelskan när den formuleras på svenska. Jag märker också att den AI-genererade texten kan innehålla skrivfel där svenskan skiljer sig från engelskan, till exempel hur versaler, kommatecken eller kolon används. Dessa är små och subtila förändringar, men det skapar en osäkerhet. Det går helt enkelt inte att lita på att texten blir korrekt.

AI hjälper inte om funktionen för texten är problemet

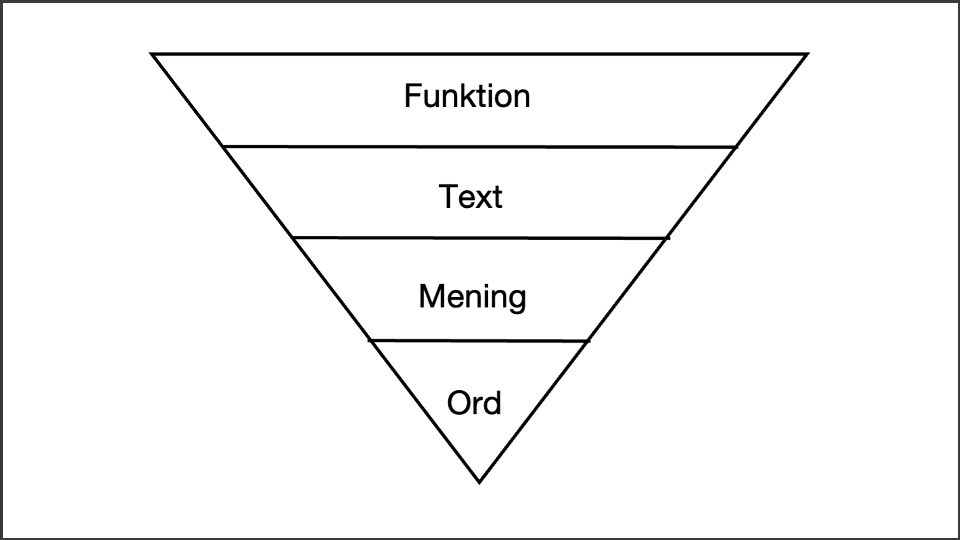

Slutligen vill jag belysa ytterligare ett problem med användningen av AI-genererad text i utställningar. Det handlar om vilken funktion texten har. En vanlig textanalytisk modell för att visa hur en text består av flera olika nivåer, är texttriangeln.

Principen för modellen är att de lägre nivåerna är underordnade de högre. De högre nivåerna berör textens funktion, vilket har att göra med textens syfte, genren, vilka som är mottagare, i vilken kontext texten finns och så vidare. De lägre nivåerna behöver anpassas så att de stämmer med de övre nivåerna. Textens funktion styr vilka språkliga medel (ordval, meningsstruktur, grammatiska val) som görs på lägre nivåer. Det går alltså inte att förbättra en dåligt fungerande text genom att bara ändra enskilda ord, eller flytta om meningar.

Att bara klistra in en halvbra text i en chatbott och be den skriva om den lite bättre kommer alltså inte nödvändigtvis ge en väl fungerande text i en utställning. Även om du ger instruktioner kring funktionen, är det inte säkert att det betyder samma sak för språkmodellen som för dig. Här krävs medvetna val av människor som kan göra bedömningar och avvägning – och som kan väga ord på guldvåg.

Kommunikation är en social process och medvetna skribenter använder språket aktivt för att skapa mening. Att skriva handlar om att göra aktiva val, både vad gäller innehåll och i hur vi organiserar en text, hur den talar till läsaren och vad den representerar. Vad en text betyder handlar alltså inte bara vad som står i den utan också hur det är skrivet och till vem eller vilka. Det låter självklart, men när det blivit väldigt enkelt att generera text som på ytan ser ut att vara korrekt, men som vid närmare granskning kan vara både partisk och generisk, blir kunskapen om hur text fungerar och agerar i en utställning av ännu större betydelse för museer.

Sofie Bergkvist

Essä

Åsikten i texten är skribentens egen. Utställningskritik förbehåller sig rätten att korrigera text i efterhand vad gäller språkfel. Övriga rättelser läggs till som kommentar under artikel.